Ja, es gibt sie, die lustigen Videos auf Tiktok. Zum Beispiel, wenn Angela Merkel, Patrick Star und Thaddäus Tentakel Deutschrap-Songs wie Kleiner Cabrón von Veysel rappen. Bebildert wird das Ganze mit einem 2D-Murmelspiel. Während die Murmeln der ehemaligen Bundeskanzlerin und der Spongebob-Figuren einen Parcours runterrollen, rappt immer die Person, dessen Murmel gerade führt. Es ist wie ein Lotto fürs Gehirn. Eine rappende Merkel ist lustig, genauso wie ein rappender Patrick.

Manche Videos dieser Art haben millionenfache Views. Der Account hinter dem Merkel-Video, MurmelHase, hat über 600.000 Likes. International ist das Format noch beliebter. Der englische Account Ultimate Marbel Race hat über 214.000 Follower:innen. Einige Videos haben über eine halbe Millionen Likes. Dass hier KI dahinter steckt, ist genauso offensichtlich wie egal – weil es keinen Schaden anrichtet. Doch das ist nicht überall so.

Auf Tiktok nichts Neues

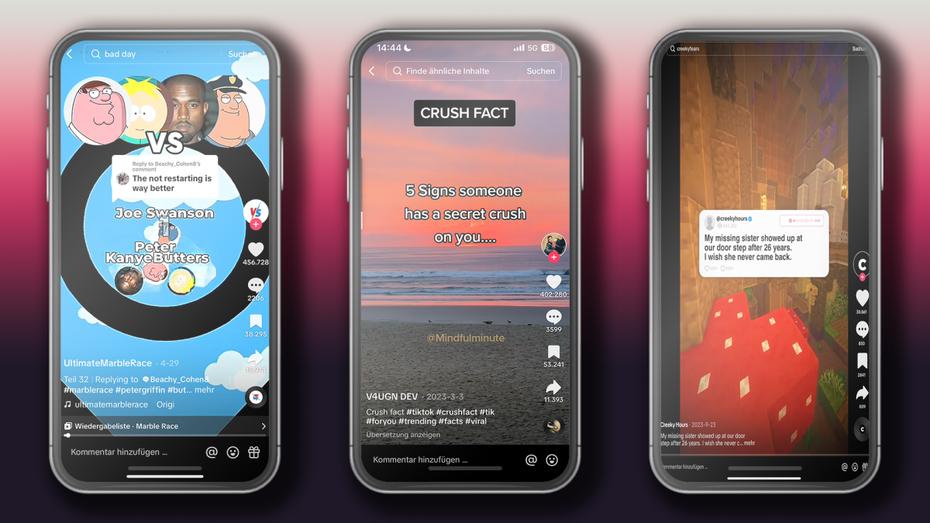

Natürlich besteht Tiktok nicht nur aus sogenannten „AI-Marbel-Races“, bei denen verschiedene Murmeln mit Promi-Gesichtern einen Parcour runterrollen und jeweils die führende Person den Song singt.

Bei AI Marbel Races weiß man nicht wirklich, wo man hinsehen soll. (Screenshot: UltimateMarbleRace / Tiktok / t3n)

Dank Tools wie Media.io oder Parrot können Promis und fiktive Charaktere alles sagen, was man will. Schon vor einem Jahr sind KI-Videos von Donald Trump und Joe Biden viral gegangen, in denen sie gemeinsam Videospiele wie Minecraft gespielt haben. Der Trend ist auch nach Deutschland geschwappt. Hier zocken Olaf Scholz und Angela Merkel zusammen.

Andere Einsätze von KI treten dezenter auf – zum Beispiel, wenn eine Text-to-Speech-Stimme Geschichten vorliest. Doch genau hier steckt mehr künstliche Intelligenz dahinter, als man denkt. Auf Youtube gibt es unzählige Tutorials, wie mithilfe von künstlicher Intelligenz klickstarke Videos erstellt werden können.

KI-Tiktoks als Business-Modell

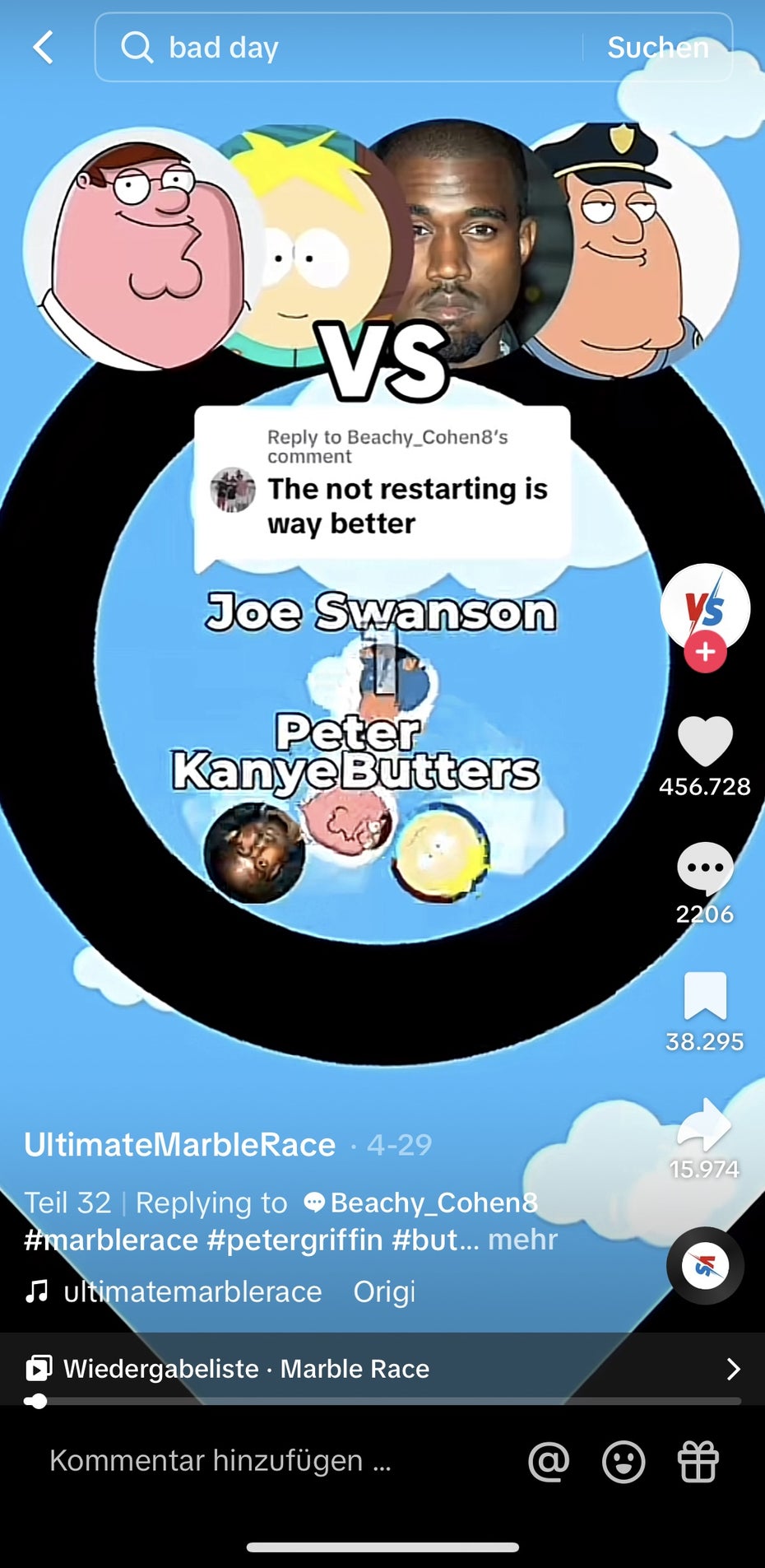

Ein Beispiel ist der Kanal AI Century auf Youtube. In einem Video zeigt er, wie man mithilfe von KI Content erstellen kann – und das soll viel Geld bringen. AI Century erklärt Schritt für Schritt, wie schnell mit wenigen Tools virale Tiktoks erstellt werden können. Dafür sollen Creator:innen einfach Storys im Internet finden und sie so umwandeln, dass sie aussehen wie ein Reddit-Post.

Im Video von AI Century ist der Kanal „Creeky Hours“ zu sehen. Manche Videos werden über eine Millionen Mal angeschaut. (Screenshot: Creeky Hours / Tiktok / t3n)

Mithilfe von ChatGPT werden die Geschichten verfeinert und beispielsweise in die Ich-Perspektive umgeschrieben. Dann soll noch ein Titel im Look eines Reddit-Posts erstellt werden. Das Gameplay-Video im Hintergrund darf auch nicht fehlen. Dann noch die Untertitel und fertig ist die virale Reddit-Geschichte.

Creator-Rewards sollen Geld bringen

Mit Tiktok lässt sich Geld verdienen. Denn die Plattform will Nutzer:innen mit dem Creator-Rewards-Programm belohnen. Schon vorher gab es den Tiktok-Creator-Fund. Videoersteller:innen, deren Videos insgesamt über 100.000 Views innerhalb von 30 Tagen und über 10.000 Follower:innen haben, können mitmachen. Damals stellte Tiktok insgesamt 200 Millionen US-Dollar Budget in Aussicht.

Mittlerweile macht die Plattform keine öffentlichen Aussagen über das Budget, das an Creator:innen ausgezahlt wird. Wie viel eine Einzelperson bekommt, lässt sich also nicht genau sagen. Unterschiedliche Influencer-Agenturen und Websites schätzen den Erlös auf circa zwei bis vier Cent pro 1.000 Views.

Laut dem Tikcalculator würde beispielsweise UltimateMarbleRace 353,51 Dollar pro Video verdienen. Deswegen locken immer mehr Leute auf Youtube mit Umsätzen von über 200.000 Dollar, die allein mit Tiktok-Videos und ohne viel Zeitaufwand verdient werden können. Dabei ähneln sich nicht alle Modelle.

Fake Facts für Geld

Einen etwas anderen Ansatz zeigt der Youtube-Kanal howtoai. Demnach sei die beste Methode, mithilfe von ChatGPT und Canva kurze Videos massenhaft zu erstellen. Dafür erstellt die Person hinter dem Kanal ein Template. Teil davon sind Thema, das Setup und die Punchline. Die Inhalte, mit denen das Template gefüllt werden soll, sind vollkommen von ChatGPT geschrieben.

Doch das Sprachmodell halluziniert. Bedeutet: ChatGPT arbeitet nicht faktenbasiert und kann richtig nicht von falsch unterscheiden. So ist einer der „Girls Facts“, die das Tool ausspuckt, dass Frauen angeblich 7.000 Wörter mehr als Männer reden. Sie würden mehr über Emotionen und Details sprechen.

Eine Meta-Studie der Linguistikforscherin Deborah James und der Sozialpsychologin Janice Drakich zeigt jedoch das Gegenteil: Die Untersuchung von 56 Studien ergab, dass nur zwei Studien darauf hindeuteten, dass Frauen mehr reden als Männer. Bei 34 Studien schienen Männer mehr zu reden. 16 der Studien kamen zu dem Ergebnis, dass die Redeanteile gleich verteilt sind und vier zeigten kein klares Muster. Doch im Video wandert der falsche Fakt bei howtoai direkt in das Template – und dadurch natürlich auch auf Tiktok.

Das Gefährliche an falschen Fakten wie diese ist auch das Umfeld, in dem sie ausgespielt werden. Nachrichtennutzung auf Social Media funktioniert „inzidentell“. Bedeutet: Wir nehmen die Botschaften nur beiläufig wahr und hinterfragen sie seltener.

Um zu zeigen, wie erfolgreich solche Modelle sind, zeigt der Account howtoai einen Tiktok-Channel, der die Methode erfolgreich nutzt: Der Kanal @smart.mentality hat 924.000 Follower:innen und über 24.6 Millionen Likes. Anscheinend sind viele Videos voller KI-generierter falscher Fakten – genau überprüfen lässt es sich von außen nur schwer, wo KI zum Einsatz gekommen ist. Bei anderen User:innen ist das wiederum offensichtlicher.

KI-Werbung auf Tiktok

Youtuber Matt Lorion preist ein System an, mit dem er 220.000 Dollar mit zwei Stunden Arbeit erwirtschaftet haben will. Anstelle von Massenproduktion setzt er auf Werbeclips – natürlich auch KI-generiert. Er nutzt das Tiktok-Affiliate-Programm. Hier können User:innen ihre Videos mit Kauflinks versehen und dadurch Kommissionen erhalten. Das Programm ist nicht in Deutschland verfügbar.

In seinem Video zeigt Lorion anhand eines Nahrungsergänzungsmittels, wie er vorgeht. Zwar nutzt er für das Skript nicht nur ChatGPT – den Abschnitt, der über die Benefits spricht, schreibt jedoch die KI. Auch hier prüft der Youtuber nicht die Faktenlage. Danach lässt er sich noch per KI Bilder zu dem Produkt erstellen und den Text von einem Text-to-Speech-Tool vertonen.

Laut dem deutschen Werberat sind KI-generierte Skripte erst einmal ethisch in Ordnung – solange die Inhalte faktisch korrekt sind. Denn: Nur selten hat man bei einer ausgestrahlten Werbung genug Einblicke in den genauen Produktionsprozess. Würden durch KI falsche Werbeversprechen gemacht werden, wird das dann aber sogar zu einem rechtlichen Problem.

Das macht Tiktok

Schon vor einem Jahr hat Tiktok Rahmenbedingungen zu KI-Nutzung in der App festgelegt. Demnach sollen Urheber:innen „Inhalte, die vollständig von Kl generiert oder wesentlich von KI bearbeitet“ sind, kennzeichnen. Dafür hat die Plattform sogar einen extra Button geschaffen.

Seit Anfang Mai will Tiktok KI-generierte Inhalte automatisch kennzeichnen. Dafür arbeitet die Plattform auch mit der Coalition for Content Provenance and Authenticity (C2PA) zusammen. Auch Google, OpenAI, Microsoft und Adobe sind Teil der Koalition, dadurch erkennt Tiktok KI-erstellte Inhalte dieser Plattform automatisch und kann sie markieren. Erkennt Tiktok die KI-Inhalte nicht, werden die Nutzer:innen gebeten, ihre Videos zu markieren. Doch häufig passiert das nicht. Nur wenige Videos, bei denen offensichtlich KI bei der Erstellung verwendet wird, haben das entsprechende Label.

Auch laut AGB haben Creator:innen relativ viel Spielraum für Arbeit mit KI. So sind die nachgemachten Promi-Stimmen ausdrücklich erlaubt, solange die Person nicht „erniedrigt oder belästigt wird, oder sich kriminell oder asozial verhält“. Außerdem dürfe sich die KI-Stimme nicht zu Produkten, Positionen oder Angelegenheiten von öffentlicher Bedeutung äußern.

Auch falsche Fakten sind laut Tiktok-AGB vollkommen okay. Hier steht zwar, dass „keine Fehlinformationen, die Einzelpersonen oder der Gesellschaft erheblichen Schaden zufügen können“, auf der Plattform erlaubt seien, jedoch setzt die Plattform die Messlatte mit dem Begriff „Erheblicher Schaden“ relativ hoch an. Diesen definiert Tiktok so: „Erheblicher Schaden bedeutet schwere Formen von körperlichem Schaden (einschließlich lebensbedrohliche Verletzungen oder Tod), psychische Schäden (einschließlich Traumata), große Sachschäden und gesellschaftliche Schäden (einschließlich der Untergrabung grundlegender sozialer Prozesse oder Institutionen).“ Ein halluzinierender Girls-Fact von ChatGPT untergräbt keine sozialen Prozesse oder Institutionen. Vielmehr bestärkt er sexistische Stereotypen.

Auf Anfrage von t3n erklärt Tiktok, dass sie als einzige Kurzvideoplattform genaue KI-Richtlinien haben. So seien Youtube und Instagram auch nicht Teil der C2PA. Zusätzlich würden nur weniger als ein Prozent der gesperrten Videos wegen der Überschreitung der KI-Richtlinien und aufgrund von Fake News gesperrt werden. Bei den auf Youtube angepriesenen Geschäftsmodellen sieht die Plattform sich nicht in der Verantwortung. Die Videos seien ja auf Youtube hochgeladen worden.

Kein Überblick

KI-Stimmen, KI-Skripte oder KI-Bilder: Künstliche Intelligenz verändert die Art, wie wir Videos erstellen. Auf Plattformen wie Tiktok wird das besonders deutlich. Hier wird KI auch als Geschäftsmodell genutzt. So können schnell Videos erstellt werden, wodurch sich viel Geld verdienen lässt.

Für Nutzer:innen kann das manchmal unübersichtlich sein: Während manche Videos gekennzeichnet sind, sind es andere trotz KI-Nutzung nicht. Eine singende Angela Merkel ist offensichtlich KI-generiert. Bei einem angeblichen Fakt oder einer persönlich wirkenden Geschichte wird es schwieriger, die Grenzen zu erkennen. Doch genau die braucht es, damit KI-generierte Desinformationen nicht zur Gefahr werden.

Genauso kompliziert ist es, herauszufinden, welche Rolle genau KI in der Erstellung spielt. Hier sind die Creator:innen gefragt: Wenn Skripte mit ChatGPT oder anderen Sprachmodellen erstellt werden, bedeutet das nicht, dass die Texte faktisch korrekt sind. Deswegen ist ein Faktencheck nötig. Denn nur mit ethischen Standards kann KI in der Videoproduktion gerecht eingesetzt werden.

Von Influencer:innen überlaufen: Diese Orte sind nach Social-Media-Hypes geschlossen: